Očekuje se da će u budućnosti takozvani “deep” lažnjaci postati istaknutiji vektor napada. Evo kako ih prepoznati.

Šta su “deep” lažnjaci?

“Deep” lažnjak je čin maliciozne zamjene stvarnih slika i video zapisa fabrikovanim kako bi se izvršila manipulacija informacijama. Da biste kreirali slike, video i audio koji su dovoljno visokog kvaliteta da se koriste u “deep” lažnjacima, potrebni su AI i ML. Takva upotreba umjetne inteligencije, ML-a i zamjene slika je za razliku od drugih vrsta manipulacije informacijama, koje koriste manje ekstremne tehnike manipulacije, kao što je lažno predstavljanje informacija, izolacija dijelova informacija ili njihovo uređivanje na obmanjujući način. Etay Maor, viši direktor sigurnosne strategije u Cato Networks-u dodaje: “Da bi se dodale komplikacije, nedavni napredak i dostupnost teksta generisanog umjetnom inteligencijom, kao što je GPT3, već su korišteni u kombinaciji s “deep” lažnjacima, kao dokaz koncepta, za stvaranje interaktivnih botova za razgovor koji izgledaju kao ljudi”.

Kako izgledaju “deep” lažnjaci?

“Deep” lažnjaci dolaze u svim oblicima i veličinama. Neki su jednostavniji, a neki napredniji. Neki od najpopularnijih primjera “deep” lažnjaka su:

Zamjena lica

Zamjena lica je čin zamjene lica u videu ili slici sa jedne osobe na drugu. Za zamjenu lica potreban je namjenski softver, ali ne mora biti baziran na naprednoj tehnologiji, danas se čak mogu naći i mobilne aplikacije koje podržavaju zamjenu lica. Zamjena lica koja je dostupna u mobilnim aplikacijama obično je ograničena na jednostavne slučajeve upotrebe, poput zamjene između fotografija korisnika i lica glumaca u filmskim scenama.

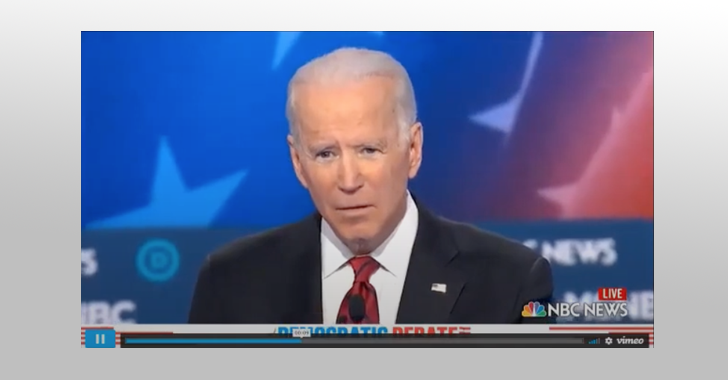

Naprednija zamjena lica postoji, ali zahtijeva više obuke modela i koda, i kao rezultat GPU-a, što je skupo i zahtijeva puno resursa. Primjer naprednije zamjene lica možete vidjeti u ovom videu, u kojem je Tom Cruise zamijenjen licem voditelja:

Ova zamjena lica Tom Cruise-a zahtijevala je dva sata obuke na GPU-u, kao i dane profesionalnog uređivanja videa nakon obrade. Ovo bi moglo zvučati puno, ali se smatralo i jednostavnijom zamjenom od drugih, jer je voditelj imao sličnu frizuru kao Cruise i može imitirati njegov glas, što znači da je bilo potrebno manje obuke i naknadne obrade.

Gospodar lutaka tzv. usna sinhronizacija

“Deep” lažnjak “Gospodar lutaka” je tehnika u kojoj se manipuliše slikom pokreta usta osobe, čineći da izgleda kao da osoba govori nešto što zapravo nije rekla. U poređenju sa zamjenom lica, koja obučava model na novom, zamijenjenom licu, ‘Puppet Master’ trenira model na licu originalne slike, a posebno na pokretima usta.

Evo kako to izgleda:

Tehnologija koja stoji iza ‘Majstora lutaka’ zasniva se na sintetizovanju maske, odnosno originalne slike, i postavljanju na vrh modela osobe koja se predstavlja i sinhronizovanju usana.

Audio

Treći istaknuti tip “deep” lažiranja je zasnovan na zvuku. Audio lažnjaci su audio fajlovi koji uzimaju glas stvarne osobe i čine da zvuči kao da govore nešto što nikada nisu rekli. Audio lažnjaci se stvaraju uzimanjem audio datoteka, dodjeljivanjem napomena zvukovima, obučavanjem ML modela zasnovanog na napomenama da poveže zvukove s tekstom i zatim generisanjem nove audio datoteke.

Evo kako zvuči:

“Deep” lažnjak ili jeftini uradak

Nisu sve modifikovane slike ili zvuk “deep” lažnjaci. Dok su “deep” lažnjaci mediji sintetizovani ili modifikovani pomoću AI-a, jeftini uradci su mediji sintetizovani ili modifikovani korištenjem metoda niske tehnologije, koje je lako uočiti. Često imaju izobličenja i njima se jasno manipuliše. Evo kako izgleda jeftin uredak:

Kibernetički rizik od “deep” lažnjaka

“Deep” lažnjaci postali su realističniji i dostupniji, a kreiraju se i brže nego ikada prije. To ih čini moćnim oružjem. Kao rezultat toga, oni predstavljaju rizik i za kompanije i za zemlje. Mogu se koristiti za kibernetički kriminal, društveni inženjering, prevaru, od strane hakera kako bi uticali na strane operacije i još mnogo toga.

Na primjer, “deep” lažnjak je korišten da bi se oponašao glas CEO-a i uvjerio izvršni direktor da prebaci 243.000 dolara na vanjski bankovni račun, i na taj način izvršena prevara. Etay Maor iz Cato Networks-a kaže: “Poslovni email se sastoji od phishing napada koji se sve teže otkrivaju na osnovu jednostavne analize jezika koji se koristi. Postoji potreba za holističkim pristupom, kao što je onaj koji nudi SASE rešenje jednog dobavljača, koji može otkriti napad na različitim višestrukim tačkama prigušenja i ne oslanjati se na proizvode izolovane tačke koji su osuđeni na propast.” U drugom slučaju, “deep” lažnjak je predstavljen kao dokaz u predmetu starateljstva nad djecom.

“Deep” lažnjaci se mogu koristiti i za širenje dezinformacija, odnosno lažne distribucije informacija radi uticaja na javno mnijenje ili zamagljivanja istine. Na primjer, “deep” lažnjaci mogu se koristiti za lažno predstavljanje svjetskih lidera i izazivanje napada, ili za lažno predstavljanje izvršnog direktora i manipulisanje cijenom dionica kompanije. U drugim slučajevima, “deep” lažnjaci omogućavaju uvjerljivo poricanje, u kojem ljudi mogu poricati sve izvore medija tvrdeći da su lažnjaci, što stvara manjak povjerenja u društvu.

Konačno, “deep” lažnjak se može koristiti za klevetu, odnosno narušavanje nečijeg ugleda. Na primjer, stvaranjem osvetničke pornografije.

Kako otkriti “deep” lažnjake?

Postoje dvije glavne metoda za precizno otkrivanje “deep” lažiranja:

- Metode detekcije niskog nivoa

- Metode detekcije visokog nivoa

Metode detekcije niskog nivoa

Metode detekcije niskog nivoa oslanjaju se na ML modele koji su obučeni da identifikuju artefakte ili pikselacije koje su uvedene kroz proces lažnog generisanja. Ovi artefakti mogu biti neprimjetni ljudskom oku, ali modeli, koji su obučeni na stvarnim slikama i lažnim slikama, mogu ih otkriti.

Metode detekcije visokog nivoa

Metode detekcije visokog nivoa koriste modele koji mogu identifikovati semantički značajne karakteristike. To uključuje neprirodne pokrete, poput treptanja, položaja glave ili jedinstvenih manira i neusklađenosti fonema i vizeme.

Danas se ove metode detekcije smatraju tačnim. Međutim, kako se tehnologija lažiranja poboljšava i postaje sofistikovanija, očekuje se da će one postati manje efikasne i da će ih trebati ažurirati i poboljšati. Pored ovih tehnika, svako od nas može pomoći u otkrivanju “deep” lažnjaka provjeravanjem medijskog izvora videozapisa i slika koje primamo.

Izvor: The Hacker News